هندسة “العقل” الرقمي

حين تجرأ الإنسان على نسخ نفسه

في جمجمتك، يقبع الجسم الأكثر تعقيداً في الكون المعروف.

كيلوغرام ونصف من المادة الهلامية، تستهلك طاقة تعادل مصباحاً خافتاً (٢٠ واط)، لكنها قادرة على إدارة شركة، كتابة سيمفونية، تذكر رائحة الطفولة، واتخاذ قرارات مصيرية في أجزاء من الثانية.

لأكثر من ٧٠ عاماً، وقف علماء الحاسوب أمام هذا “الدماغ” بحسرة وانبهار.

كانت حواسيبهم العملاقة قادرة على إجراء حسابات فلكية لا يستطيع الدماغ البشري مجاراتها، لكنها كانت تعجز أمام مهام يتقنها طفل في الثالثة من عمره: مثل التمييز بين القطة والكلب، أو فهم نبرة السخرية في جملة عابرة.

المشكلة لم تكن في سرعة المعالجة، بل في التصميم. الحواسيب التقليدية كانت تعمل بشكل خطي متسلسل (١ + ١ = ٢). أما الدماغ البشري، فيعمل بشكل “شبكي” متوازٍ.

من هنا ولدت الفكرة الجريئة:

لماذا نحاول اختراع العجلة من جديد؟

إذا أردنا صنع آلة تفكر مثل الإنسان، فعلينا أن نبنيها من الداخل.. مثل الإنسان.

في هذا المقال، نغوص في عالم “الشبكات العصبية” (Neural Networks)،

المحاولة البشرية الكبرى لمحاكاة البيولوجيا بالسيليكون، لنفهم كيف تحولت الأسلاك الباردة إلى ما يشبه الخلايا الحية.

١. الإلهام البيولوجي: من الخلية إلى المعادلة

لكي نفهم الشبكات العصبية الاصطناعية، يجب أن نلقي نظرة سريعة على الأصل البيولوجي.

دماغك يتكون من حوالي ٨٦ مليار خلية عصبية (Neurons).

هذه الخلايا لا تعمل بمفردها، بل تتصل ببعضها عبر تريليونات من “الاشتباكات” (Synapses).

عندما ترى صورة صديقك:

تشتعل مجموعة من الخلايا في شبكية العين، ترسل إشارة كهربائية لخلايا أخرى في الدماغ تميز “الأشكال”، ثم تمر الإشارة لطبقة أخرى تميز “الملامح”، وصولاً للطبقة التي تصرخ: “هذا أحمد!”.

قوة الاشتباك بين هذه الخلايا هي ما يشكل “الذاكرة” و”المعرفة”.

العلماء أخذوا هذا المخطط، وحولوه إلى رياضيات.

العصبون الاصطناعي (Perceptron) هو مجرد حاوية للأرقام. بدلاً من الإشارات الكهربائية، نحن نمرر “بيانات”. وبدلاً من الاشتباكات العصبية العضوية، نستخدم “الأوزان” (Weights) التي شرحناها في المقال الأول.

الشبكة العصبية هي ببساطة:

آلاف أو ملايين من هذه “العصبونات الاصطناعية” مصفوفة في طبقات، تتحدث مع بعضها البعض بلغة الأرقام.

٢. تشريح الشبكة: كيف يتدفق “التفكير”؟

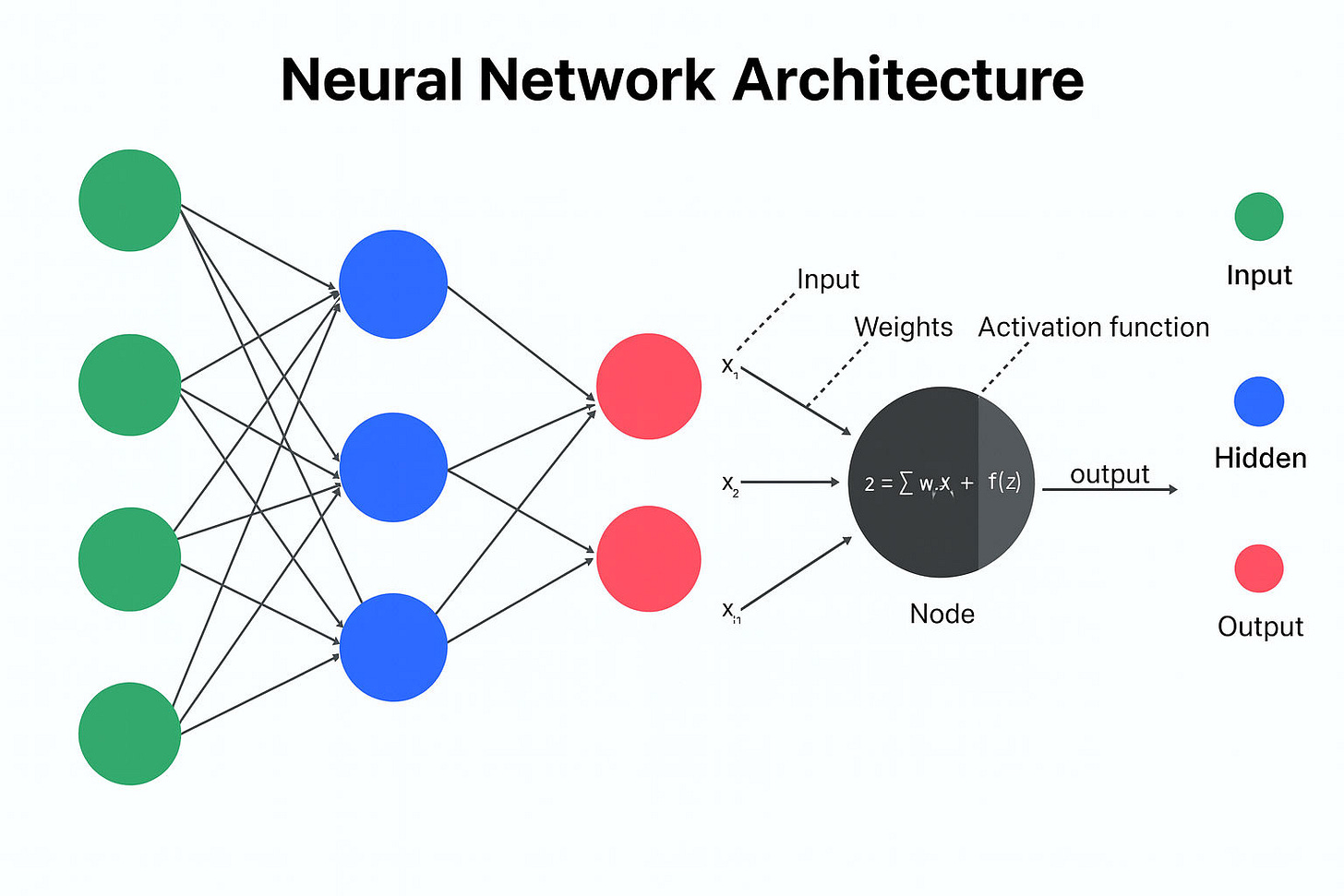

أي شبكة عصبية، مهما كانت معقدة (مثل تلك التي تشغل ChatGPT)، تتكون من هيكل أساسي من ثلاث مراحل. تخيلها كمؤسسة ضخمة لمعالجة المعلومات:

أولاً: طبقة الإدخال (The Input Layer) - “الحواس”

هذه هي واجهة الشبكة مع العالم الخارجي.

إذا كانت الشبكة تحلل صورة، فهذه الطبقة تستقبل البيكسلات (أرقام تمثل الألوان).

إذا كانت تحلل نصاً، فهي تستقبل الكلمات (محولة إلى أرقام). هذه الطبقة لا “تفكر”، هي فقط “ترى” وتنقل ما رأته لمن خلفها.

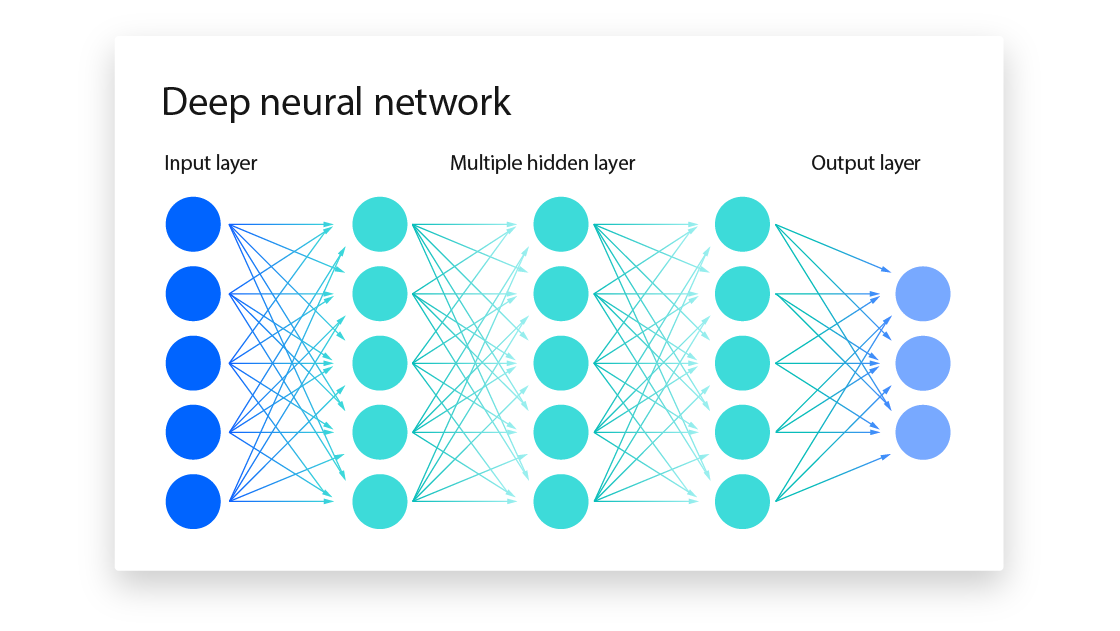

ثانياً: الطبقات الخفية (The Hidden Layers) - “المطبخ السري”

هنا يحدث السحر..

وهنا يكمن مصطلح “التعلم العميق” (Deep Learning).

سميت “خفية” لأننا لا نرى مدخلاتها ومخرجاتها بشكل مباشر، وسميت “عميقة” لأنها تتكون من طبقات عديدة متراصة فوق بعضها.

في الطبقة الأولى، قد تتعلم الشبكة التعرف على “الخطوط المستقيمة”. ف

ي الطبقة الثانية، تجمع الخطوط لتتعرف على “الأشكال الهندسية”.

في الطبقة الثالثة، تجمع الأشكال لتتعرف على “عين” أو “أنف”.

كل طبقة تسلم الشعلة للتي تليها، مع مستوى أعلى من التجريد والفهم. هذا التسلسل الهرمي هو بالضبط ما يمنح الشبكات العصبية قوتها الجبارة.

ثالثاً: طبقة الإخراج (The Output Layer) - “القرار”

هذه هي المحطة الأخيرة.

بعد أن مرت البيانات عبر كل الطبقات الخفية، وتم طحنها وتحليلها، تصل إلى هنا لتعطيك النتيجة النهائية:

“هذه صورة قطة بنسبة ٩٧٪”، أو “الكلمة التالية في الجملة هي: المستقبل”.

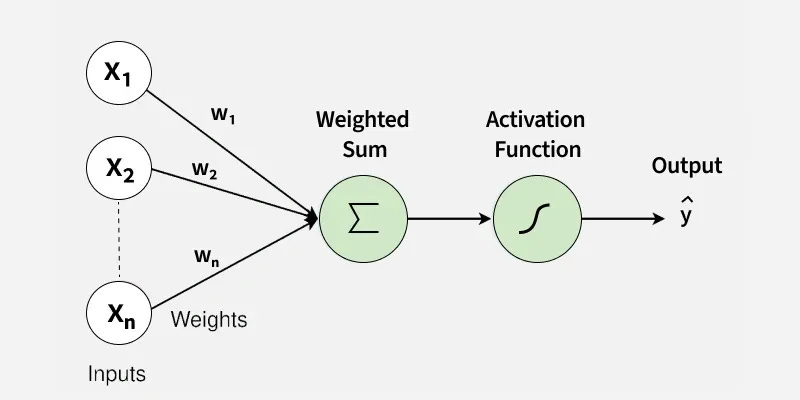

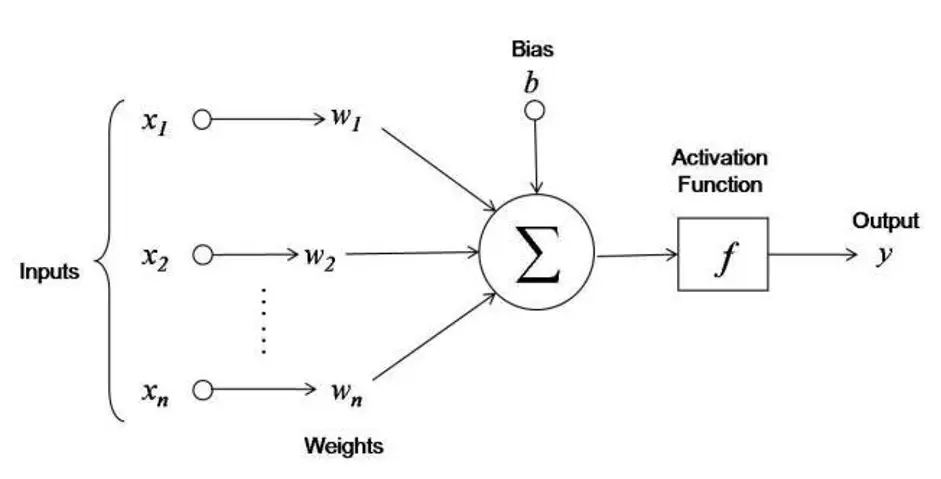

٣. ديمقراطية الخلايا: الوزن والانحياز

داخل هذا الهيكل المعقد، كيف تتخذ خلية واحدة قراراً بتمرير المعلومة للخلية التالية أم لا؟

الأمر يشبه عملية تصويت دقيقة جداً، تعتمد على عنصرين أساسيين، هما جوهر “شخصية” الشبكة:

١. الوزن (Weight):

أهمية الصوت تخيل أنك تستشير ثلاثة أصدقاء لشراء سيارة.

صديقك الميكانيكي له “وزن” كبير في رأيك.

صديقك الذي لا يملك رخصة قيادة له “وزن” منخفض جداً.

الشبكة تفعل المثل. كل اتصال بين خليتين له “وزن”. أثناء التدريب، الشبكة تعدل هذه الأوزان. إذا كانت الخلية (أ) تساهم دائماً في الإجابة الصحيحة، تزيد الشبكة من “وزن” اتصالها، فتصبح كلمتها مسموعة أكثر.

٢. الانحياز (Bias):

نقطة البداية أحياناً، تحتاج الشبكة لدفعة إضافية أو كبح جماح.

الانحياز يشبه “المعتقد المسبق”.

مثلاً، إذا كانت الشبكة مصممة لبيع المظلات، فقد يكون لديها “انحياز” سلبي للبيع في الصيف، حتى لو كانت كل المؤشرات الأخرى جيدة. الانحياز هو رقم يضاف للمعادلة لزحزحة القرار نحو القبول أو الرفض بناءً على السياق العام.

وعندما تجتمع الأوزان والانحيازات، تمر النتيجة عبر ما يسمى “دالة التنشيط” (Activation Function).

هذه الدالة هي “البواب”.

هي التي تقرر: هل الإشارة قوية بما يكفي لتنتقل للخلية التالية؟

أم يجب أن تموت هنا؟

بدون هذا “البواب”، ستصبح الشبكة مجرد عملية ضرب خطية مملة، ولن تستطيع فهم التعقيدات غير الخطية في عالمنا (مثل المشاعر، أو فهم النكتة، أو تمييز الوجوه).

٤. لماذا الآن؟ سر الانفجار الكبير

فكرة الشبكات العصبية ليست جديدة.

لقد ظهرت نظرياً في الأربعينيات والخمسينيات من القرن الماضي!

فلماذا انتظرنا حتى العقد الأخير لنرى هذا الانفجار في الذكاء الاصطناعي؟

لماذا لم يظهر ChatGPT في الثمانينات؟

الجواب يكمن في عاملين، يشبهان توفر “الوقود” و”المحرك”:

البيانات (الوقود):

الشبكات العصبية، وخاصة “العميقة” منها، هي وحوش جائعة للبيانات. لكي تعمل بدقة، لا يكفيها ألف مثال، بل تحتاج للملايين والمليارات. ثورة الإنترنت هي التي وفرت هذا المحيط الهائل من الصور والنصوص لتدريب هذه الشبكات.

قوة الحوسبة (المحرك):

العمليات الحسابية داخل الشبكة العصبية بسيطة (ضرب وجمع)، لكنها هائلة العدد. نحن نتحدث عن تريليونات العمليات في الثانية. المعالجات القديمة (CPU) كانت عاجزة عن ذلك. الإنقاذ جاء من مكان غير متوقع: ألعاب الفيديو. وحدات معالجة الرسومات (GPUs) التي صممت لترسم جرافيكس الألعاب بسرعة، تبين أنها مثالية تماماً لحسابات الشبكات العصبية. هذه الرقائق (مثل التي تصنعها Nvidia) كانت المفتاح الذي أخرج المارد من القمقم.

٥. حدود المحاكاة: هل هي واعية؟

رغم كل هذا التعقيد، ورغم أننا سميناها “عصبية” تيمناً بأدمغتنا، يجب أن نقف لحظة تواضع وتوضيح.

هذه الشبكات تحاكي الدماغ، لكنها ليست دماغاً.

الدماغ البشري مرن، ديناميكي، ويستهلك طاقة ضئيلة، ويمتلك ما نسميه “الوعي” أو الشعور بالذات.

الشبكات العصبية الحالية هي أنظمة إحصائية جامدة (Static). بمجرد انتهاء تدريبها، هي لا “تتطور” أثناء حديثك معها (إلا في سياق الذاكرة المؤقتة). هي لا تشعر بالألم إذا أخطأت، ولا بالفرح إذا أصابت.

هي خرائط رياضية عالية الأبعاد. عندما تكتب الشبكة قصيدة، هي لا تشعر بالحزن أو الحب. هي قامت بتحليل ملايين القصائد البشرية، ورسمت خريطة للعلاقات بين الكلمات، وسارت في الطرق التي تؤدي إحصائياً إلى بناء أبيات موزونة ذات معنى. النتيجة تبدو إنسانية مذهلة، لكن الآلية ميكانيكية بحتة.

وهذا، في رأيي، لا يقلل من شأنها، بل يزيده إبهاراً. أن نتمكن من بناء هيكل من “الجماد” ينتج “إبداعاً”، هو إنجاز هندسي لا يصدق.

خاتمة: اكتمال الصورة

الآن، لنربط الخيوط ببعضها في رحلتنا هذه:

في المقال الأول، تعلمنا أن لغة الذكاء هي الرياضيات (المتجهات والمصفوفات).

في المقال الثاني، عرفنا كيف تكتشف الآلة القوانين بنفسها عبر تعلم الآلة.

واليوم في المقال الثالث، عرفنا الهيكل الذي يحتوي كل هذا: الشبكات العصبية وطبقاتها العميقة.

لقد بنينا الأساس: لدينا الرياضيات، ولدينا طريقة التعلم، ولدينا الهيكل (الدماغ الرقمي).

السؤال الآن هو: ماذا يحدث عندما نغذي هذا الدماغ الرقمي بكل نصوص الإنترنت؟

كل كتب التاريخ، وكل المقالات، وكل حوارات البشر؟

هنا نصل إلى الثورة الحالية.

هنا نصل إلى النماذج اللغوية الكبيرة (LLMs). كيف تحولت هذه الشبكات العصبية من مجرد “مصنفات” للصور، إلى “مفكرين” ومبدعين ومتحدثين بارعين؟

هذا هو موضوع مقالنا القادم.. حيث سنفكك لغز ChatGPT وإخوانه.

هل بدأت الصورة تتضح؟ عالم الذكاء الاصطناعي يبدو معقداً من الخارج، لكنه مبني على مبادئ منطقية متراكمة.

إذا كنت تستمتع بهذا التحليل العميق والمبسط في آن واحد، فتأكد من أنك مشترك في القائمة البريدية، لأن القادم هو التطبيق العملي لكل ما تعلمناه.

🔗 شارك هذا المقال مع من يهتم بفهم “ما خلف الكواليس” للتقنية التي تغير عالمنا. [رابط الاشتراك]

وإلى لقاء قريب في الفصل الرابع.