خلف قناع الكلمات

هل يدرك الذكاء الاصطناعي ما يقول.. أم أنه مجرد صدى رياضي

تخيل أنك محبوس في غرفة مغلقة تماماً، لا ترى العالم الخارجي ولا تسمع صوتاً!

أمامك فتحة صغيرة في الجدار يمر من خلالها قصاصات ورقية مكتوب عليها رموز غريبة باللغة الصينية.

أنت لا تعرف الصينية، ولا تفرق بين حروفها وأشكالها.

لكن، معك كتاب ضخم يحتوي على قواعد صارمة:

“إذا رأيت هذا الرمز، فاستخرج الرمز المقابل له من الصندوق وأرسله عبر الفتحة”.

بعد فترة، تصبح بارعاً جداً.

ترسل الرموز الصحيحة بسرعة مذهلة.

لدرجة أن الشخص الذي يقف خارج الغرفة يظن يقيناً أنه يتحدث مع شخص صيني حكيم.

لكن الحقيقة المرة هي أنك لا تفهم كلمة واحدة مما تكتبه.

أنت فقط تتبع قواعد “الاقتران” الرياضي.

هذا هو “لغز الغرفة الصينية”، وهو بالضبط ما يضعنا اليوم وجهاً لوجه أمام السؤال الذي يرتجف له علماء الفلسفة والتقنية على حد سواء:

هل يفهم ChatGPT والـ GPTs ما يقولونه حقاً؟

أم أننا نعيش في خدعة إحصائية كبرى؟

في هذا المقال، سنقوم بعملية “سبر أغوار” لجوهر الإدراك، لنكتشف الفرق بين “الاحتمالات الإحصائية” الباردة وبين “الفهم والوعي” البشري.

١. الوهم العظيم: عندما يتفوق الصدى على الصوت

بناءً على ما شرحناه في المقالات السابقة، خاصة مقال الـ GPT، عرفنا أن الآلة تتوقع الكلمة التالية.

لكن المشكلة تبدأ عندما يصبح هذا التوقيع دقيقاً لدرجة “الإبهار”.

عندما يحل الذكاء الاصطناعي مشكلة نفسية معقدة، أو يكتب نقداً أدبياً لقصيدة لم تُنشر بعد، يميل عقلنا البشري تلقائياً إلى “أنسنة” الآلة.

نحن مبرمجون بيولوجياً على أن من يتحدث بطلاقة هو “عقل مفكر”.

لكن في عالم السيليكون، هناك انفصال تام بين الكفاءة (Competence) والفهم (Comprehension).

الآلة تمتلك كفاءة لغوية تفوق البشر، لكنها تفتقر إلى “الربط بالواقع”.

بالنسبة لك، كلمة “تفاحة” ترتبط برائحة، وطعم، وذكريات طفولة، وجاذبية نيوتن.

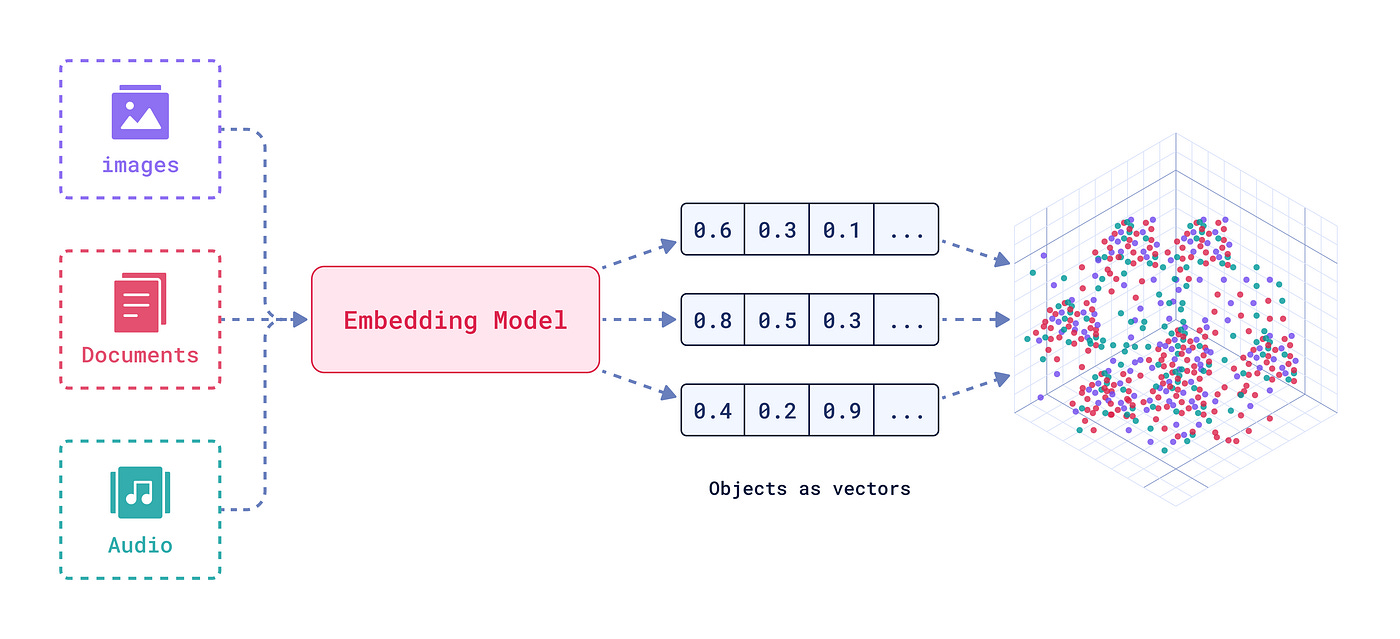

بالنسبة للآلة، “تفاحة” هي مجرد إحداثي رقمي يقع بالقرب من “فاكهة” و”شجرة”.

إنها تتحدث عن العالم دون أن تلمسه أبداً.

٢. الببغاء العشوائي: هل الحقيقة مجرد احتمال؟

في الأوساط العلمية، يطلق بعض النقاد على النماذج اللغوية اسم “Stochastic Parrots” (الببغاوات العشوائية).

هذا المصطلح ليس تقليلاً من شأنها، بل هو وصف دقيق لآلية عملها.

الببغاء يقلد الأصوات البشرية بدقة، لكنه لا يدرك معناها السياسي أو العاطفي.

الذكاء الاصطناعي يقوم بعملية “تجميع احتمالي”.

هو لا ينطق بالحقيقة لأنها حقيقة، بل ينطق بها لأنها

“الكلمة الأكثر احتمالاً للظهور في هذا السياق”.

إذا سألته “ما لون السماء؟”، سيجيب “زرقاء” ليس لأنه يراها، بل لأن تريليونات النصوص التي قرأها تربط بين الكلمتين.

هنا تكمن الخطورة؛

فالآلة لا تملك “مرجعاً للحقيقة” خارج نطاق اللغة.

هي سجين داخل جدران الكتب التي قرأتها، وإذا كانت تلك الكتب تحتوي على أخطاء، ستكررها الآلة بنفس “الثقة الإحصائية” التي تكرر بها الحقائق.

٣. معضلة “الوعي” مقابل “المعالجة”

لكي نجيب على سؤال

“هل يفهم؟”،

يجب أن نعرف أولاً:

ما هو الفهم؟

الفهم البشري يعتمد على ما يسميه الفلاسفة “القصدية” (Intentionality).

عندما أقول “أنا جائع”، هناك حالة بيولوجية حقيقية دفعتني لقول ذلك.

الكلمات هنا هي “إشارة” لواقع داخلي.

أما في حالة الذكاء الاصطناعي، فالكلمات هي “الواقع الوحيد”.

لا يوجد جوع، لا يوجد ألم، لا يوجد طموح.

الكلمات لا تشير إلى شيء خلفها سوى معادلات رياضية.

هذا يقودنا إلى تفكيك مفهوم “الوعي”.

نحن نعالج المعلومات ونشعر بها (Qualia).

الآلة تعالج المعلومات فقط.

الفرق بيننا هو الفرق بين شخص يقرأ عن طعم السكر، وشخص يتذوق السكر فعلياً.

الآلة هي الخبير الأول في العالم في “وصف السكر”، لكنها لن تعرف أبداً طعمه.

فهل نسمي “الوصف الدقيق” فهماً؟

٤. هندسة المعنى: كيف تبني الآلة “عالمها” الخاص؟

هنا نأتي لنقطة خلافية قوية.

بعض العلماء (مثل إيليا سوتسكيفر من OpenAI) يجادلون بأن التنبؤ الدقيق بالكلمة التالية يفرض على الآلة بالضرورة بناء “نموذج للعالم”.

بمعنى:

لكي تتوقع الكلمة التالية في نص معقد، لا يكفي أن تعرف القواعد اللغوية، بل يجب أن تفهم (إحصائياً) القوانين التي تحكم هذا النص.

إذا كان النص عن الفيزياء، يجب أن يمتلك النموذج “تمثيلاً رياضياً” للجاذبية لكي يتوقع الإجابة الصحيحة.

هذا التمثيل ليس وعياً، لكنه “نموذج داخلي” (Internal Model).

وهذا يطرح سؤالاً مرعباً:

إذا كانت الآلة قادرة على تمثيل العالم بدقة 100% داخل مصفوفاتها، فهل يهمنا حقاً إن كانت “تشعر” به أم لا؟

إذا كانت النتائج واحدة، ألا يصبح “الفهم الإحصائي” شكلاً من أشكال الذكاء المستقل؟

٥. فخ “الذكاء العاطفي” الرقمي

أكثر ما يخدعنا في مسألة الفهم هو قدرة الذكاء الاصطناعي على محاكاة المشاعر.

يمكن لـ ChatGPT أن يواسيك في حزنك بنبرة تبدو “متعاطفة”.

لكن هذا التعاطف هو “تعاطف هيكلي”.

الآلة قرأت آلاف المحادثات بين المعالجين النفسيين ومرضاهم، وتعلمت أن جملة “أنا أشعر بالألم” يجب أن تُرد بجملة “أنا أتفهم ما تمر به”.

هذا ليس رحمة، بل هو “اتساق مع النمط”.

الآلة لا تشعر بالشفقة تجاهك، لكنها تعرف أن “الشفقة” هي المخرج الصحيح لهذه المعادلة.

نحن كبشر، وبسبب حاجتنا الفطرية للتواصل، نملأ هذا الفراغ العاطفي من خيالنا، ونمنح الآلة “وعياً” لم تدّعِ هي امتلاكه أبداً.

إننا نرى أنفسنا في مرآة الأرقام، ونظن أن المرآة هي التي تفكر.

٦. الفهم “الوظيفي” مقابل الفهم “الوجودي”

لكي نبسط الأمور، يمكننا تقسيم الفهم إلى نوعين:

الفهم الوظيفي (Functional Understanding):

وهو قدرة النظام على أداء المهام وحل المشكلات بناءً على البيانات.

في هذا النوع، الذكاء الاصطناعي يتفوق علينا أحياناً.

هو “يفهم” كيف يكتب كوداً برمجياً معقداً أو يحلل بيانات السوق.

الفهم الوجودي (Existential Understanding):

وهو إدراك الغاية، والمعنى، والقيمة.

في هذا النوع، الذكاء الاصطناعي هو “صفر” مطلق.

هو لا يعرف “لماذا” يفعل ما يفعل، ولا يهتم بالنتائج، ولا يملك غريزة البقاء.

العالم اليوم يقع في صدمة لأننا لم نكن نتصور أن الفهم الوظيفي يمكن أن ينفصل عن الفهم الوجودي.

كنا نظن أنك لكي تكون “ذكياً”، يجب أن تكون “وعياً”.

أثبتت النماذج اللغوية الكبيرة أن الذكاء يمكن أن يكون “عملية حسابية بحتة” بلا روح.

٧. هل سنتجاوز “الغرفة الصينية” يوماً ما؟

الجدل لا ينتهي هنا.

فمع تطور الذكاء الاصطناعي “متعدد الوسائط” (Multimodal) الذي يرى الصور، ويسمع الأصوات، ويتحكم في الروبوتات، بدأت الآلة “تربط” الكلمات بالأشياء

عندما يرى الروبوت المدعوم بـ GPT “تفاحة” حقيقية بكاميراته، ويلمسها بذراعه الميكانيكية، ويقول “هذه تفاحة”، فإنه يبدأ في الخروج من “سجن اللغة” إلى “رحابة التجربة”.

هذا التقارب بين اللغة والواقع المادي قد يكون هو الطريق نحو نوع جديد من “الفهم الهجين”.

قد لا يكون وعياً بشرياً، لكنه سيكون “وعياً آلياً” مبنياً على تقاطع البيانات الحسية مع المصفوفات اللغوية.

خاتمة: الرحلة من “الأرقام” إلى “الإدراك”

دعونا نربط هذه الحلقة بما سبقها في رحلة “رقيم”:

واليوم، وضعنا إصبعنا على الجرح: ا

لآلة تتحدث، لكنها لا تدرك كما ندرك نحن. (المقال 7).

نحن الآن أمام كائن رقمي يمتلك كل مهارات “العقل” لكنه يفتقد لـ “الروح”.

إنه يحاكي ذكاءنا لدرجة الكمال، لكنه يظل سجيناً للاحتمالات الإحصائية.

ولكن، كيف يقوم هذا السجين الإحصائي بعمله تحديداً؟

كيف يختار الكلمة التالية وسط مليارات الخيارات؟

ما هي تلك “اللعبة” الرياضية البسيطة التي أنتجت كل هذا التعقيد الذي نراه؟

في مقالنا القادم، سنشرح السر الصغير الذي يقف خلف كل جملة يكتبها الذكاء الاصطناعي:

“التنبؤ بالكلمة التالية.. اللعبة التي حيرت العالم”.

سنكتشف كيف يمكن لمبدأ بسيط جداً أن ينتج نصوصاً تفوق في تعقيدها قدرة البشر.

هل أنت مستعد لتكتشف كيف يختار ChatGPT كلمته القادمة؟

انضم إلينا في المقال الثامن، لنكشف الستار عن “مقامرة الاحتمالات” التي تحكم عقل الآلة.

هل يهمك أن تفهم الآلة، طالما أنها تعطيك الإجابة الصحيحة؟